沙发理论:好与坏

米塞斯和西尔能教埃利泽尔·尤德科夫斯基和其他受错误抽象诱惑的人们一些什么教训。

古希腊哲学家提出了这样一种理论,认为整个世界(包括人体)由四种元素组成:水、空气、火和土。他们从未试图严谨地解释血液与空气的相似之处,只说血液是热和湿润的,但这种无望的隐喻思维仍在17世纪之前主宰着西方医学。

对大多数人来说,“四元素理论”只是一个古老的好奇心,但对我来说,这总是让我着迷,人们如何能认为这样一组荒谬的想法是人类智慧的巅峰。甚至连想象力无限的古希腊思想家们在使用他们最基本的工具来探索世界时,如何相信这一理论呢?

当然,答案是人类的思维(甚至是最伟大的思维)往往太容易屈服于基于表面相似性的伪见解所产生的虚假显而易见。特别是当他们通过不依赖于外界帮助的推理链或坐在椅子上推理来形成自己的理论时。

扶手椅上的理论思考和人工智能

如果你认为椅子理论化作为构建有影响力的论据的工具已经死亡和埋葬,那就再想想吧。它最近有影响力的化身是AI安全辩论的灾难主义者派别,其中最大的支持者是Eliezer Yudkowsky。

尤德科夫斯基在所谓的“理性主义”社区的小范围辩论中花费了数十年时间制定和完善他的观点。他完全相信当前AI发展轨迹最终会导致一种超级智能,这种超级智能将不可避免地迅速消灭人类。

近期公布的GPT3.5和4以及它们的竞争对手面向消费者的大语言模型的戏剧性公开露面使尤德科夫斯基备受关注。GPT4相对于GPT3.5的快速主要改善使他确信,除非采取激烈措施,否则人类已经无望。包括Bengio和Hinton在内的AI行业领袖和大批关注AI趋势的其他人的出现,给予尤德科夫斯基的观点一层正当性的外观。

抓住机会,尤德科夫斯基要求彻底禁止人工智能研究。他甚至走得太远,呼吁如果某些国家偏离这样的禁令,轰炸重要的数据中心以消除威胁。

然而,唯心主义理论总是不好的吗?

有人可能会告诉我,“等等,不是所有的坐在椅子上进行的理论推测都是坏的,我知道一个明显的例子,你会认为它是正确和很棒的。米塞斯的经济计算论反对社会主义。”

理论的主旨如下:

想象一下现代经济中的所有资源。所有具有不同能力的人、所有机器和原材料等。人们可以用不同的方式组合这些资源来生产商品。但是,要如何决定使用哪些资源来做什么?更糟糕的是,社会主义中央计划委员会该如何为整个经济做出决策呢?

Mises的深刻洞见是,即使保留了消费品的价格,在没有生产资料的私有财产和因此不存在自由市场的情况下,将无法理性地比较资源使用。中央规划委员会将是盲目运行的。

即使苏联最终也不是米塞斯所讨论的社会主义的例子。因为它可以模仿西方科技并了解西方人想要消费的商品。然而,苏联仍然是经济上的灾难,在生产大量没人需要的东西以及在其他方面大规模的资源错配。它最终像纸牌一样迅速倒塌,并震惊了西方经济学家。而当他们的所谓的储蓄(没有实际的生产能力支持)变成了泡沫时,我父母就更加震惊了。因为原本足以购买一辆汽车的大笔资金,结果只能够购买一块口香糖。如果西方经济学家和我父母读过米塞斯的著作,他们本可以看到这一切的发生。

为什么米瑟斯的论证是一个例子的书斋理论呢?这是因为米瑟斯没有实证证据来说明社会主义经济如何在实际操作中运作。当他出版这本书的时候,更不用说开始写它的时候,苏联实际上还没有实施计划经济。它只是试图控制谷物的价格。

而苏联究竟正在发生什么,这些信息可能对米瑟斯来说也没有详细得可得到。

然而,尽管花费了数十年时间来证明他是正确的,而且即使大多数经济学家仍然不愿尝试理解他的论点并且相信苏联在经济上的失败只是因为激励不足,但是米塞斯最终证明了他惊人的预见力。为什么尤德科夫斯基不能成为我们这个时代被忽视的米塞斯呢?

米瑟斯和尤德考斯基的不同之处是什么?

Mises与Yudkowsky的不同之处在于概念构建的层面。 Mises用于他的论据的概念-资本货物,消费品,价格,利润和损失,生产计划等-都是从现象中概括出来的,可以在没有特殊工具或定量数据的情况下熟悉。

这是一个很好的抽象化做得不错的例子,这种方式已经被亚里士多德讨论过,具有讽刺意味的是,他自己也常常没有遵守它。

什么是尤德科夫斯基的职责?AI发展可能带来的后果以及其危险性,归根结底是关于智能本质的问题。或许,在考虑超级智能AI是否会想要杀死人类方面,感知和意向的问题也很重要,但只有在真正可能出现超级智能AI的情况下才有意义。

然而,尤德科夫斯基似乎并不在乎智能(或者说心智)是什么。实际上,对于他来说,从狗到国际象棋程序Stockfish再到人类,每个事物都是一个心智。

它(ChatGPT - D.G.)比以前的人工智能代际显著更加通用。人类比以前的黑猩猩或者更确切地说是南方古猿或者最后共同祖先显著更加通用。

人类并不完全通用。如果人类完全通用,我们在编码、足球、投掷物品或奔跑方面的能力将同等出色。我们中的一些人在编程方面还可以,但我们并不是为此而设计的。我们的思维能力不是完全通用的。

因此,即将消灭我们的超级智能,是否会把我们的原子变成订书钉或者造出快速且普遍致命的微生物呢?简单来说,它就像是一个全能的 Stockfish,在所有任务中都能胜过人类。如 Yudkowsky 所说:

当它下一步棋时,你不能做得比它更好。它可能不是最优的棋步,但如果你选择不同的棋步,你会做得更差。这可以称为行动的一种效率。鉴于它赢得比赛的目标,一旦你知道了它的棋步,除非你咨询比Stockfish更强大的人工智能,否则你找不到比它更好的棋步。

一个超级智能就像是与一切、与整个人类有关。对人类来说它是相对高效的。它拥有最好的估计值——不是完美的估计值,但是是最好的估计值——而且它的估计值包含了你关于它的所有信息。它的行动是实现其目标最高效的行动。如果你认为你有更好的方式来实现它的目标,那么你是错误的。

但这个理念只表面上看起来简单而有吸引力,因为它把智能的本质掩盖了起来。看起来,狗、Stockfish和GPT4所做的事情与人类所做的事情类似:在它们的限制内解决问题。

但真正的智慧并不主要在于此。它在于对世界的概念理解。比如像我们经验中的日常物品或数字,这些是孩子们只需几个例子就能学到的。或者是我们从经济理论中学到的价格和资本货物的概念。

当然,大多数现代哲学家(就像他们的古代前辈一样)会争辩(错误地)说我们没有真正好的概念,因为我们不能定义“猫”是什么,也不能排除有一天“猫”会生下一只小狗的可能性。实际上,一位希腊的犬儒主义者在数千年前就已经打乱了他们的局面,嘲笑柏拉图认为“人类是羽毛less的两足动物”的定义。或者有人会说,一些过于狂热的米塞斯的粉丝是当一个人试图从所有的演绎推理中得出所有的结论时会发生什么的一个例子。

但是,正如现代亚里士多德哲学家道格·拉思曼恩所指出的那样,这将会误解定义的本质。定义的作用在于使我们能够区分特定概念的实例,以便说出这只慵懒发出呜呜声的绒球加上胡须和可缩进的爪子是一只猫,而不是一只狗或兔子。

人工智能是否具有对世界的概念把握?

暂且不谈狗或黑猩猩是否可以构建概念,(在我看来)人工智能是否对世界具有概念把握?事实上,当一个人学习它们的训练方式后,就可能开始怀疑它们的能力。它们需要数以百万的同一类别/活动示例才能学会它。而一旦情境变化(例如采用古怪的围棋策略),人工智能就会彻底迷失。有时,这可能会带来悲剧性的后果。

为什么ChatGPT在某些任务上如此出色呢?它为什么能够正确回答数百万个问题,而没有一个活着的人能够做到这一点呢?这是因为它摄取了人类创造的大量文献,这些文献虽不完美,但确实被人类所理解。

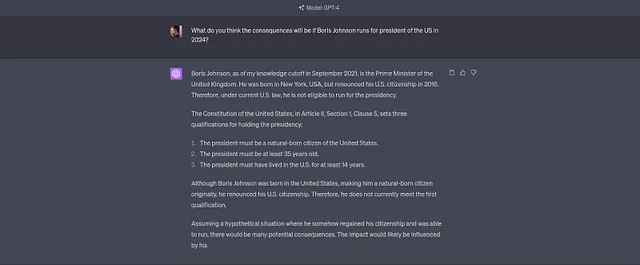

请问GPT 4如果波里斯·约翰逊在2024年竞选美国总统会有什么后果,它会正确地回答说,他已放弃了他最初通过出生获得的美国公民身份,因此不符合资格。

一个人可以在那里停下来,决定人类注定要失败,或至少,整个行业很快会变得不必要。但人们也可以想知道GPT4是从哪里获得灵感的,并找到这篇2014年的BBC文章。

但是GPT4确实不理解什么是国籍或总统职位。它只是复制所接受的训练模式。

AIs无法逃脱中文房间。

更普遍地说,即使像基于大规模统计模型的GPT4这样的AI和我们更熟悉的计算机程序之间似乎存在世界性差异,更不用说1980年存在的那些了,但AI仍然是对1980年一本书首次提出的论点的完美阐述。具有讽刺意味的是,那篇论文也涉及(好的)躺椅理论化。

当然,我正在谈论塞尔的《心智、大脑与程序》中最著名的争议。塞尔要求我们想象一个被锁在房间里但能够使用指令和象形字与外界的中文使用者交流的人。即使他们没有学过一个中文单词,如果他们成功地欺骗了中文使用者相信他们理解了中文,那么他们能被说理解了中文吗?

Searle正确指出,它们不能,也没有其他只操作符号(具有“语法但没有语义”的)系统能够理解任何东西(无论其计算能力如何)。后来,Searle会意识到计算机甚至没有语法,因为只有人类可以在它们上面看到语法,但我题外话了。

人工智能不理解任何事情真的有关系吗?

我想象尤德科夫斯基这样的人会说,无论人工智能是否真正能够理解世界的概念,这并不是特别重要的问题。Stockfish可能不知道什么是兵和车,但没有人类能够战胜它,那么对于一个普适的Stockfish的论点仍然成立,不是吗?

它不行。首先,人工智能是否真正能够从经济或采用方面理解问题。如果某物真的不理解任何事情,它将在边缘案例或对抗情境中遭受(常常不可预知的)失败,这可能会损害甚至阻止其在边缘案例事项重要时的采用。问问正在开发无人驾驶汽车的公司就知道了。鉴于强大的人工智能需要巨大的计算成本,其供应商需要很快获得显着的收益来维持人工智能的改进工作。

但更重要的是,正如AlphaZero被业余围棋玩家羞辱一样,如果AI真的没有理解一项活动,那么它可能会被实际上能够理解该活动的人类所智胜。而且,如果一个被专门训练在围棋上表现卓越的AI可以被业余玩家打败,那么普通的任务导向型AI...你懂的。

世界迫切需要更好的抽象化处理

本文的结论是,无论是你从GPT4获得的响应多么令人印象深刻,还是那些波士顿动力机器人的舞蹈,每个人都应该停止担心超级智能人工智能可能杀死我们所有人(或我们的后代)。每个人都应该意识到,计算机程序(或者说狗)能够以人类的意义聪明是错误的联想思维的一个突出例子,人类很容易受到这种思维方式的影响。

而这种思维方式甚至在2023年仍然流行。数亿人仍然相信非物质存在,因为他们可以想象到一只烟雾缭绕的幽灵材料化身出现与他们交谈,并且因为他们不将思想视为物质。

大多数经济学家认为,使用关于代理人知晓所有可能商品或类似物品组合的扭曲模型是可以接受的。

即使是学术物理学家也认为讨论空间或时间的收缩是有道理的,因为他们将空间与一个理想化的橡胶板混为一谈,而将时间与时钟所显示的时间混为一谈。

如果更多的人,特别是知识分子和学者,采用正确的抽象方法,世界会变得更加美好。