我们能训练野马成为工作马吗?

分享我早春的部分专业日程安排…

2023年2月10日至12日:我正在监控由印度理工学院坎普尔校区主办的第11届IIT技术大赛的进展情况。

2023年2月26日:我在一所有声望的管理学院教授了一门关于人工智能/机器学习及其在人力资源技术方面的影响的课程。这是我在过去几年中非常享受的一项任务。

2023年3月4日:与出席印度理工学院曼迪基金会日庆典的客人一起参观了派拉夏湖和瑞瓦尔萨尔湖。

这些事件看似不相关,但是让我揭示它们的一个惊人共同点。

进入排行榜。

声名显赫的Inter IIT技术会议的消息(第11届于2023年2月中旬在IIT Kanpur举行)引起了我的兴趣。由于黑客马拉松中技术人才的涌现,我是这些技术节的热切观察者。这些节日是识别至关重要的技术人才的可靠渠道。企业赞助商渴望在新兴的技术人才中保持自己的可见性,并且真正有竞争争夺赞助商头衔。

期待已久的结果出来了。我猜测第一代印度理工学院将获得前几名的位置。但令人惊喜的是,新一代的印度理工学院超过了年长而备受尊重的印度理工学院,其中印度理工学院曼迪位列前十!能够进入备受推崇的排行榜是一项令人满意的成就。

就像几乎所有人一样,我受到了“锚定”偏见的影响,将第一代IIT作为参考点,认为在资源和声誉上,它们会压倒竞争对手。但是我被证明是错误的,我感到很高兴!

在这个竞争激烈的论坛中,才华不是精选学院的专属领域。这些活动理所当然地庆祝个人的才能和勇气,而不是他们代表的学院。

人力资源管理中的困扰。

2022年11月,ChatGPT的推出席卷了人工智能/机器学习领域。我喜欢向管理类专业的年轻学生教授AI/ML课程,因为它帮助我跟上这些迅猛发展的技术。这是一个两年一次的练习。课程介绍了在人力资源管理领域中应用AI/ML的相关性和应用。“人工”智能似乎是在“人力”资源管理(HRM)领域中教授的不恰当概念,这正是它有趣的地方。

讲座部分关注人力资源工具的扩散及其理论基础,人力资源技术领域中的初创企业,以及风险投资家对人力资源技术的兴趣。顾名思义,招聘流程是最适合在人力资源管理领域采用人工智能/机器学习等技术的流程。如果有了招聘流程,那么对偏见的研究肯定离不开,无论是基于人为的偏见还是算法产生的人工智能工具的偏见。类似“验证”、“光环效应”、“相似性”、“群体思维”和“锚定”的偏见在人才招聘过程中以显著的方式影响着。

原本的颜色可能不是蓝色。

任何访问曼迪的游客都被鼓励前往该区域外围环绕的惊艳淡水湖泊旅行;即帕拉舍尔湖、瑞瓦尔萨尔湖、卡姆鲁纳格湖和塞瓦尔萨尔湖。当我们谈论这些原始湖泊时,什么颜色会引发我们的联想呢?蓝色,不是吗?这要感谢照片、艺术作品和书籍插图中对水体普遍的蓝色描绘。

哪种颜色给喜马偕尔邦的那些湖泊染上了色彩?

绿色!

我们认为蓝色是原始湖泊的经典颜色,而不是“绿色”。我们仅仅基于湖水的颜色,就将某些品质和特点归结于它。偏见不可避免地溜进了这种观念中。

然而,湖水的颜色感知取决于许多因素,例如水的深度、阳光的角度、藻类和其他水生植物的存在以及水的化学成分。这些因素会导致湖水呈现不同的蓝色或绿色。喜马偕尔邦这些“绿色”湖泊的水被认为是神圣的和纯净的,当地人保证其可饮用。

偏见悄悄地、被动地渗入。

这些轶事展示了一个人在生活中的典型日常中所表现出的无意识偏见。生活中充满了偏见。这些例子可能看似无害。但它们可以被忽视吗?

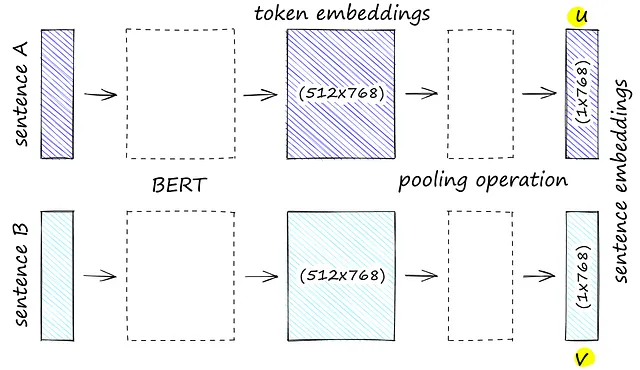

无意识偏见非常微妙,它会悄悄地潜入我们的内心,而我们可能并不自知。我们中的大多数人甚至可能没有意识到自己的思维是有偏见的。将人类从方程式中取出,用AI算法取代人类大脑,并不能解决这个问题。为什么?因为AI工具是从存档的人类数据中设计出来的。机器学习涉及从存档数据中学习,但它并不是真正的理解。

我们正在创造一匹野马——野马吗?

在撰写本专栏时,呼吁ChatGPT的继任者暂停开发更强大的人工智能系统的呼声已经出现!可能试图让马慢跑而不是奔跑!!

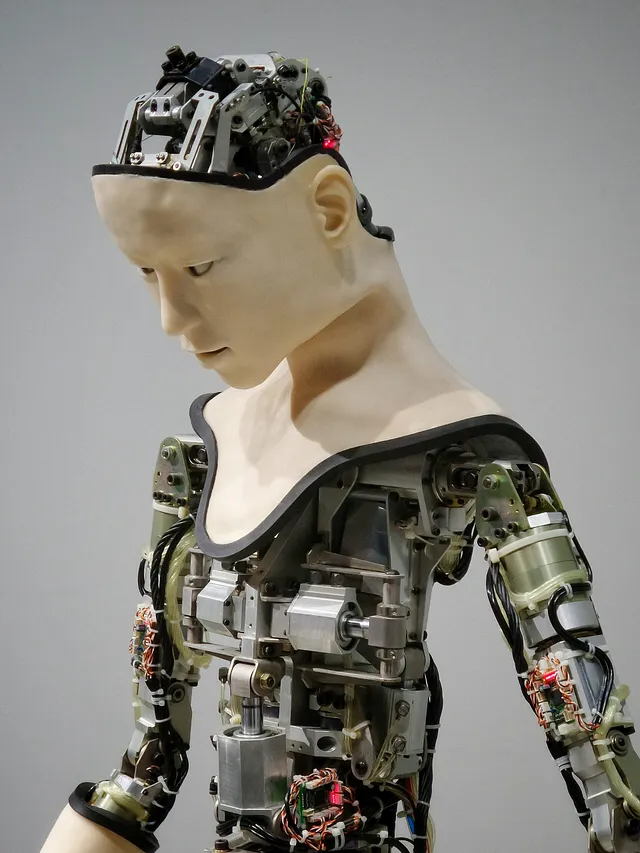

大型语言模型(LLMs)通过生成算法快速前进,同时接受文本和图像输入,并起草“学习得来”的回复,而不是“经过思考”(或理解)的回复。

输出结果会是事实正确的吗?当技术报告缺乏相关细节时,我们能否了解思维过程的内部运作?

我们都知道,数据的培训来自于互联网上“已经”存在的数据可被挖掘。是否有害的偏见和刻板印象正在大规模地被“大型语言模型”所合并?虽然可能会提供解释称,数据集越大,其多样性和代表性就越强,但谁负责定义“大”是谁呢?我们是否正在通过对机器施加的规则创建技术上的“野马”?

我们能把野马驯服成工作马吗?

我们是否正在处理处理大型数据集的懒惰工作方法?这是否会给智能方法寻找含义并在筛选数据集上进行训练造成了视野狭窄?野马能否被驯服成为工作马?

管理像ChatGPT中使用的生成式人工智能这样强大的技术,需要在使用前有意识地做出以下行动,而不是事后才考虑。基本规则应该是:

为了在团队和能力上带来多样性。多元和跨学科团队可以帮助识别同质团队无法捕捉和采取行动的偏见。

接下来就是数据清理和维护的重要性了。需要确保用于训练算法的数据是干净的,并代表着整个人群,以减少偏差的影响。

持续测试和评估是绝对必须的。这是防止潜在偏见产生的方法。

告别的话

隐性偏见始于童年时期。这是人脑发育其神经中心和训练其视觉、听觉和嗅觉能力时。我们变得喜欢已知和熟悉的模式,并将其视为“好的”(回想第一代IIT作为品牌),而未知和陌生的则被怀疑对待(记住“绿色的”湖)。

虽然所呈现的轶事并不具有恶意,但社会弊端的根源可以追溯到个体中所表现出来的无意识偏见或在聚集的群体中因社交媒体而加剧。仇恨言论、令人作呕的暴力以及针对某个社群的社会污名,都是在很大程度上表明了隐藏性偏见的行为。

让我们放下偏见并持开放态度,不要让技术加剧它。虽说这很容易说但做起来有难度,我们应坚持不懈。