Certainly! Here's the translation of "Chatbots Cannot Be “Fixed”" in simplified Chinese, while maintaining the HTML structure: ```html

聊天机器人不能被“修复”

```

Sure, here is the translated text in simplified Chinese, while maintaining HTML structure: ```html

虽然谷歌承认了聊天机器人的不足,但如果他们认为增加更多的机器智能策略就足以将句子预测聊天机器人转变成类似人类洞察力的机器,那他们就是在自欺欺人。

```Sure, here's the translation of the text into simplified Chinese, maintaining the HTML structure: ```html

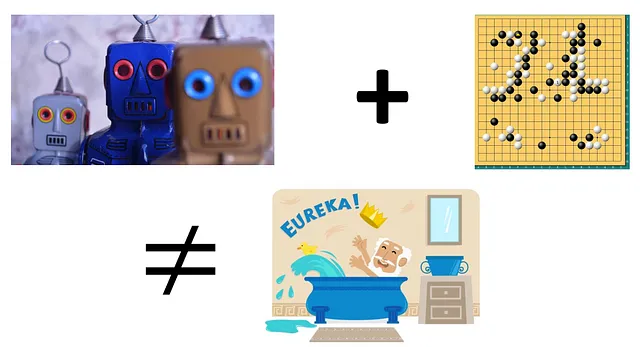

Wired Magazine: “Several years before ChatGPT began jibber-jabbering away, Google developed a very different … artificial intelligence program called AlphaGo [and] have now [combined] … the AI behind today’s chatbots with … a successor to AlphaGo …” [1]

``` And the translated text in simplified Chinese: ```html《连线》杂志:“在ChatGPT开始胡言乱语之前的几年,谷歌开发了一个非常不同的……名为AlphaGo的人工智能程序[和]现在已经[结合]……今天聊天机器人背后的AI与……AlphaGo的后继者……” [1]

``` This translation keeps the original HTML structure intact while providing the text in simplified Chinese.Sure, here's the translated text in simplified Chinese, keeping the HTML structure intact: ```html

Google已经认识到ChatGPT或“生成式人工智能”的不足之处,足以积极寻找避免胡言乱语的方式,而不是检索经过充分验证的事实。如果Google能重新专注于从全球范围内检索相关事实,而不是插入低质至极糟的相关广告,并利用生成式人工智能假装他们“拥有”从过去用于返回答案的网站上获取的事实,那就更好了,但每个公司都有自己的商业策略。

``` This HTML snippet contains the translated text in simplified Chinese, formatted as a paragraph.```html

尽管存在各种炒作,所有形式的生成AI归根结底都是基于过去有多少人完成过类似句子来完成句子。您必须添加一些随机性,以防止它们总是以最平淡和最有可能的完成方式回答。例如,如果您要求一个LLM完成句子“我喜欢我的宠物 [?]”,它通常会返回“狗”,但有时也会是“猫”。如果设计师感到兴奋并增加随机性,您可能偶尔会得到“袋鼠”甚至是“水熊虫”。

```Sure, here's the translated text in simplified Chinese while keeping the HTML structure: ```html

除非你把随机噪音称为“生成的”,否则生成式人工智能什么也不生成。它只是获取过去人类讲话中最平淡乏味的平均文本,对这些词语的含义理解不比随机翻开一页的字典更多。

``` This HTML snippet contains the translated text in simplified Chinese, maintaining the original structure.```html

缺乏理解和随机化的使用意味着即使是最乏味、最明显的问题,你也永远不能完全信任聊天机器人的答案。这种固有的不确定性与传统的谷歌搜索形成鲜明对比,后者在不随机化事实的情况下为你提供最佳可用页面。随机化不仅仅防止了单调的答案,并且提供了足够混淆来源的内容,谷歌可以声称其人工智能“学习”了这些页面的内容,据称像人类一样,因此不受剽窃的法律责任约束。更简单的事实是,添加噪音以掩盖来源根本不算学习,而是一种欺骗性和本质上不可信的剽窃形式。这种缺乏类人学习的情况在你给予聊天机器人名词和动词组合,而这些组合在训练期间根本不像它们所遇到的任何东西时,表现得最为明显。随着你达到统计句子训练的极限,答案质量迅速下降。

``` In simplified Chinese: ```html缺乏理解和随机化的使用意味着即使是最乏味、最明显的问题,你也永远不能完全信任聊天机器人的答案。这种固有的不确定性与传统的谷歌搜索形成鲜明对比,后者在不随机化事实的情况下为你提供最佳可用页面。随机化不仅仅防止了单调的答案,并且提供了足够混淆来源的内容,谷歌可以声称其人工智能“学习”了这些页面的内容,据称像人类一样,因此不受剽窃的法律责任约束。更简单的事实是,添加噪音以掩盖来源根本不算学习,而是一种欺骗性和本质上不可信的剽窃形式。这种缺乏类人学习的情况在你给予聊天机器人名词和动词组合,而这些组合在训练期间根本不像它们所遇到的任何东西时,表现得最为明显。随着你达到统计句子训练的极限,答案质量迅速下降。

``````html

The AlphaGo/AlphaZero approach of simulating and exploring an extremely large space of simulated problems is powerful as long as you have enormous computational resources and a reasonably bound simulation space. However, since physical reality is never a reasonably bound simulation space, this method only learns what you put into your assumptions about how the physical world. The AlphaGo/AlphaZero exhaustive exploration approach thus cannot fix the fundamental problem with LLM tech: LLM is dumber than a stump but talks fluently with a nice sentence structure. You must also overlook the point that all versions of LLM steal other people’s ideas, sometimes with permission but more often not, and can easily go full-tilt psychotic if you ask them questions completely unlike any they’ve seen before.

``` 简化中文翻译: ```htmlAlphaGo/AlphaZero 方法通过模拟和探索大量的仿真问题空间,在拥有巨大计算资源和合理边界的仿真空间时非常强大。然而,由于现实世界从不是一个合理边界的仿真空间,这种方法只能学习您对物理世界假设的内容。因此,AlphaGo/AlphaZero 的详尽探索方法无法解决LLM技术的根本问题:LLM比树桩还笨,但可以流利地进行语言交流。您还必须忽略这一点:所有版本的LLM都会窃取他人的想法,有时会经过许可,但更多时候不会,并且如果您问他们从未见过的问题,它们很容易变得完全失控。

```Certainly! Here's the translated text in simplified Chinese, keeping the HTML structure: ```html

LLM(大脑模型学习)和模拟空间的枯竭,无论是单独存在还是结合起来,都仅限于在发光的营销简报中重现人类问题洞察力。我们需要更多更基础的研究,探索受生物启发的认知和脊椎动物主要非数字智能的惊人能效。

``` This HTML structure wraps the translated Chinese text in a paragraph (``) tag, maintaining the original structure as requested.

Certainly! Here's the HTML structure with the translated simplified Chinese text: ```html

[1] W. Knight,《Google DeepMind的游戏AI挑战聊天机器人的盲点》,Wired Business,2024年7月25日,东部时间11:30(2024年)。https://www.wired.com/story/google-deepmind-alphaproof-ai-math/

``` In simplified Chinese: ```html[1] W. Knight,《Google DeepMind的游戏AI挑战聊天机器人的盲点》,Wired Business,2024年7月25日,东部时间11:30(2024年)。https://www.wired.com/story/google-deepmind-alphaproof-ai-math/

``` This HTML snippet keeps the original structure intact while presenting the translated citation in simplified Chinese.