AI所涉及的一切都遭受到质疑

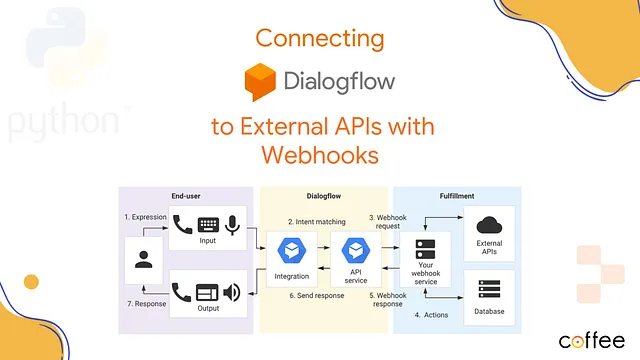

发生的不仅仅是在市场控制上的争夺。一些大型科技公司正在努力塑造我们的未来。他们正在向我们展示他们认为社会应该是怎样的,以及他们对人类的信仰。他们假装这一切都是因为自然的市场力量,但实际上他们正利用他们的资金和权力来控制人工智能技术的创造和使用,以及背后的研究。

人工智能不仅仅是聊天机器人——它是一个广阔的研究领域。现在引起关注的一个部分是机器学习,它不仅仅是关于预测我们的行为,还包括生成内容,即所谓的生成式人工智能。机器可以使用语言很酷,但更像是机器的行为和模仿,有时甚至是欺骗我们,而不是真正具有创造力、准确性或理解力。

技术看似自我发展的原因是有人在推动 —— 他们并没有真正谈论重要的事情。他们无视与他们希望让我们思考的东西不一致的事实。

在硅谷,高层人士表现得好像他们知道什么是最好的,并且这种观念在一个人人认为事情就是这样的文化中变得更加强烈。当下一个大事物出现时,所有人都对此感到疯狂 - 公司、投资者、媒体和重要人物都在大张旗鼓。

他们使用听起来不错的词语来让我们对他们所做的事情感到满意,比如公平、创造力、开放性和安全性。在关于人们行为的课程中,设计师被告知让事物变得简单,以便我们可以毫不费力地做事。

我们喜欢事情快捷简单的想法,这让我们感兴趣。如果我们说我们不喜欢某样东西,他们会说我们只是不理解或者我们在伤害世界。没有人希望看起来不喜欢进步。科技领导者表现得像他们关心每个人的利益,并要求一点控制权,科技就会一直无处不在地渗透到我们的生活中。

现在,很明显这导致了人们分裂、对话变得糟糕和社会混乱。大科技企业获益最多,而其他企业和社会的重要部分也纷纷加入其中,使自己的问题更加严重。本应帮助我们的领导者只关注利用这些新事物来让自己看起来很好,并没有关注帮助我们看清问题。

他们谈论着保障我们的安全和做正确的事情,但实际上,大公司只是在保护自己。没有人阻止他们,他们从实验室测试产品,就将我们当作试验品,而不问我们是否同意,是否只有聪明才是重要的。

有很多不同类型的风险,而且它们都很大。我们需要考虑长期风险和当前正在发生的风险。由于深度伪造而看起来真实的谎言,保持我们的信息私密的问题,以及计算机做出不公平选择 - 所有这些都让我们对信任感越来越少。我们还不真正知道像失业或伤害环境这样的事情会有多糟,以及我们是否希望让机器替我们做出选择。

有些风险甚至让我们质疑何为人类。如果我们更关心聪明而不是自己思考,我们会变得像机器吗?如果事情继续按照现状发展,或许我们将失去对谁决定什么对我们有利的发言权。剥夺我们人性的不仅仅是失去它的唯一方式。

最重要的事情应该是让人们开心和善待他们,而新的想法应该有助于此。我们可以从互联网刚开始时借鉴经验 - 权力在大公司和小公司之间、普通人和商业之间以及政府和商业之间进行分享。这样做使事物更加顺利和安全。

人工智能一次接管所有事情并不是必然的,只要我们运用聪明才智来质疑开发人员和工具。商界和政府的领导者不必盲从硅谷和其他人的强烈意见,可以适当减缓进程。

我们可以花时间制定使用人工智能的良好规则,确保每个人都被公平对待并保护我们的权利。我们还可以鼓励人们以公平的方式学习人工智能,不伤害任何人,以便我们能够不断推出新的好事物。

如果我们思考一下什么才是真正重要的,并制定一些好的规则,人工智能可以帮助科学、健康、创办新业务,为我们的生活增添幸福,并保持人们的独特和特殊。

以简洁的中文说明

感谢您成为我们社区的一部分!在您离开之前:

- 一定要鼓掌并关注作者!👏

- 你可以在PlainEnglish.io找到更多的内容 🚀

- 注册我们的免费每周新闻简讯。🗞️

- 在Twitter(推特)、领英(LinkedIn)、YouTube和Discord上关注我们。