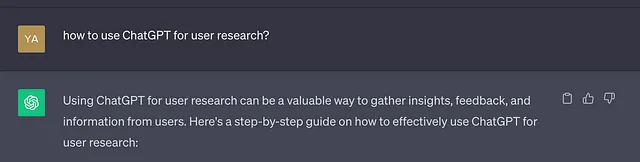

金融服务行业通过生成式人工智能用于企业软件开发。

这并非言过其实,尽管生成式人工智能仍处于初级阶段,却已经席卷全球。该技术的投资正迅速增长(仅2023年上半年就得到了超过125亿美元的资金[1]),大量初创企业涌现出来,展示了商业界对这一新领域的乐观态度,可谓是一次彻底的范式转变。各行各业的企业已经开始探索解锁生成式人工智能潜力以在许多方面获得竞争优势的方法,而金融服务行业也不例外。

产生式人工智能在这个行业中的使用案例涵盖了价值链的多个部分,包括营销和销售、客户体验以及企业支持职能等。然而,本文侧重于产生式人工智能在企业领域的编码能力,全面地探讨了它所提供的机会和面临的挑战。

背景

在公共领域的大量数据上对LLMs(大型语言模型)进行训练,无意中赋予了这些模型学习编程语言(如Python和R)以及理解其与口语语言接口的能力。随后,通过进一步整理公共编码库,这些模型得到了对编程语言更有针对性的学习。

Open AI的Codex是一个显著的例子,它在大规模学习领域开创先河,然后与GitHub合作构建Co-Pilot,旨在提高其性能并扩大其能够熟练理解的语言范围[2]。

使用

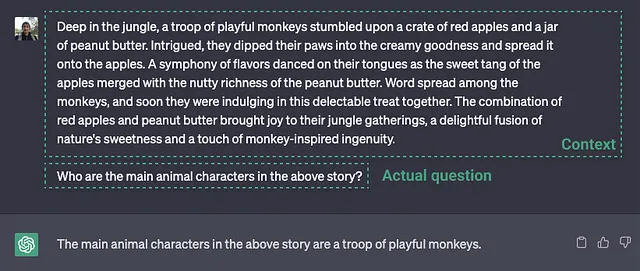

在软件开发生命周期中,生成式人工智能可以发挥其技能,提高流程的整体生产力。

- 在开发阶段,它可以生成代码的初步草稿,对现有代码提出最佳实践建议,并诊断和调试问题。

- 在整合阶段,它可以将代码转换为不同语言,为迁移软件模块提供初始指导。

- 生成式人工智能不仅可以合成测试数据,还可以运行测试并审核结果,从而加速测试阶段。它还可以协助撰写技术文档。

生成 AI 可以借助其技能来提升软件开发过程的整体生产力。

挑战

然而,需要注意的是,任何生成代码的提示都必须具有高度规范性,并且仅限于常见的任务,因为与即使是初学者的人类程序员相比,它的能力很低,无法理解更广泛问题的背景[3]。此外,它只能对简单的代码块给出准确的结果,并且在实现复杂任务链时存在困难[4],虽然这可能在中长期内得到改善。

虽然生成式人工智能承诺成为软件开发中的一种革命性增强工具,但在高度监管且需求复杂多样的银行业中存在一些实际限制需要充分考虑。对于生成式人工智能在编码应用案例中的三种部署模型,这些挑战各不相同,使得每家金融机构都需要自行选择适合自己的平衡点。

生成性AI在编码用例中的三种部署模型:

i) 一个可公开获取的现成产品

ii) 在一个严格限制的环境中进行优化的模型

iii) 以专有数据为基础的法学硕士学位

第一个,也是最可行的选择是使用各个供应商提供的现成产品套件。这样可以立即获得技术,并且价格最便宜。然而,在这种情况下,供应商会保留每个输入和输出的数据,这使得这个选择在一开始对于需要高标准数据隐私和治理的金融机构来说是不可行的。

第二个选择是在一个有限制系统中为一个经过精密调整的模型付费,这个模型由所有主要供应商提供,可以确保公司数据保持受限。虽然这解决了隐私问题,但还存在许多挑战。

首先,由于尚未明确定义使用公开源数据来训练模型的程序员的权利,存在第三方知识产权侵权的高风险。其次,使用此类公开数据将限制银行在竞争激烈的市场中展示差异化的能力。此外,从公开数据中提取的代码容易受到安全漏洞的影响[5]。因此,有必要考虑第三种选择,以可能规避这些问题。

金融机构可以选择使用专有编码数据来建立和培训自己的LLM,以避免与数据合规性和版权相关的问题。然而,它们不太可能拥有培训这类模型所需的广度和深度的专业数据(Open AI使用数十亿行代码来培训其LLM)。即使大量高质量、全面的数据存在以满足银行复杂需求,内部培训这样一个模型所涉及的底层计算碳排放量(大约数百吨)也可能会显著损害它们的ESG评级。

此外,维护活动可能是软件服务中最重要的部分,无论采用何种部署方法,都会面临自身的挑战,因为引入任何重大更新可能需要重新训练模型,使其使用变得不切实际。

"软件维护会在所有部署方法中带来挑战,因为这可能需要重新训练模型,使其使用变得不切实际。"

简而言之,尽管生成式人工智能可能对金融服务业的软件开发人员的生产力带来重大提升,但专业编码数据库和深入的主题知识专长的重要性并不会减弱。

参考资料

[1] "银行业中的生成式人工智能",金融科技控制中心,BCG X,2023年7月

[2] "生成式人工智能:AI基于自动编码在软件开发中的影响," OMDIA,2023年3月

[3] "代码合成大型语言模型的危险分析框架",Open AI,2022年7月

[4] “对于基于代码训练的大规模语言模型的评估”,OpenAI,2021年7月

[5]“评估 GitHub Co-pilot 的代码贡献的安全性”,IEEE安全与隐私研讨会,2022年

请您让我知道任何错误、遗漏或改进意见。

免责声明:本个人博客中表达的观点仅属作者个人,并不与任何机构有关联。未包含任何公司的私人/专有信息。

照片来源:Rawpixel