探索语言的模糊性:ChatGPT与人类沟通的反思

"在AI聊天机器人时代揭示原创与回收语言的悖论"

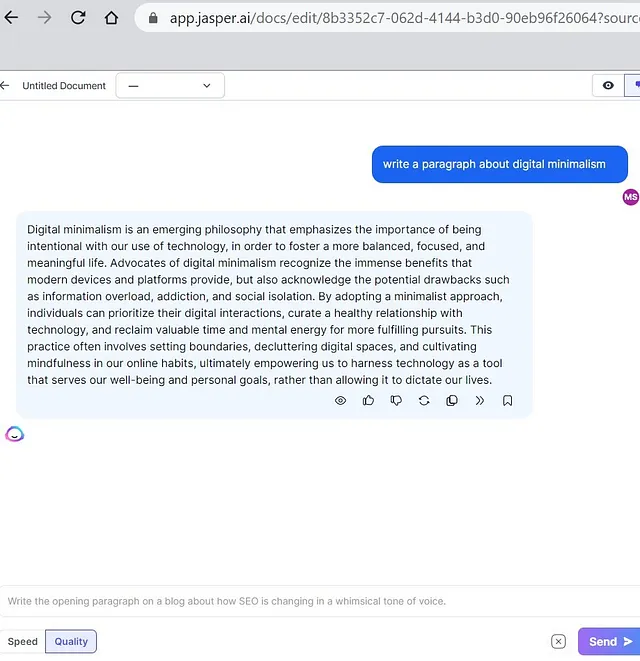

聊天GPT周边的讨论常常陷入“毁灭炒作循环”,一方面关注学术诚信问题,另一方面推广其好处。尽管与ChatGPT的互动可能感觉新奇,但在通信方面,人与机器之间的界限比通常承认的模糊。像确认不是机器人或依赖于电子邮件客户端和手机提示词这样的情况,引发对我们自身独创性和潜在机器人影响的疑问。

语言变革辩论并不新颖,ChatGPT 最吸引人的方面在于人类对其的反应。这些反应揭示了我们对语言的信念以及我们与 AI 交互对象不断发展的关系。 Chatbots 作为人类语言的一面镜子,展示了我们创造力的能力以及重复利用已经存在于人类交互中的语言模式的倾向。

著名语言学家诺姆·乔姆斯基及其同事认为聊天机器人只能描述和预测,而无法解释,暗示它们处于认知进化的非人类阶段。然而,人类也依赖于回收语言,而不是不断生成新的短语。语言人类学家米哈伊尔·巴赫金强调了与他人思想的互动和斗争在塑造我们的语言和思想中的作用。即使是抄袭也比看起来更加复杂,因为沟通经常涉及共享的想法和短语。

AI技术揭示了人类语言不仅仅是从零开始创造新短语。例如,AI疗法应用程序Woebot是通过人类治疗师使用人对人的治疗对话进行培训的。同样,当词曲作家Colin Meloy要求ChatGPT按照他自己的风格写歌词时,结果平平,但令人惊讶地类似于他的乐队的一首歌曲。这反映了人类编写的流行歌曲和政治演讲的倾向,借鉴和利用现有作品。因此,新语言和再循环语言之间的区别仍然模糊不清,引发了关于我们自己的人性和AI类人特性的问题。