谷歌警告员工注意聊天机器人

这个故事的关键事实如下,经由¹路透社、²福布斯、³纽约邮报和⁴The Wrap共同认可。

- 在全球推广其聊天机器人Bard之际,谷歌母公司Alphabet Inc.正在向其员工警告如何安全地使用人工智能(AI)聊天机器人,其中包括Bard。据路透社引用四名匿名消息人士的报道。 ¹

- 该公司据说敦促其软件工程师避免直接使用聊天机器人能够创建的计算机代码,因为它称AI可以重现在培训期间接收到的数据,从而存在潜在泄漏的风险。一位三星工程师最近上传了代码到ChatGPT上,导致了这种情况的发生。²

- 这些问题已经在全球企业界变得普遍,许多跨国公司都在AI聊天机器人上加装安全限制。对一万二千名美国专业人士的调查发现,43%的人正在使用ChatGPT或其他AI工具,通常并未告知他们的老板。³

- 上个月,苹果禁止其员工同时使用ChatGPT和另一个名为GitHub的Copilot服务,而亚马逊也禁止员工与ChatGPT分享任何代码或机密信息。包括摩根大通、美国银行和花旗银行在内的银行也发布了类似的限制。²

- 随着谷歌试图推进其Bard的全球推广,它目前在欧盟是不允许的。欧盟数字监管机构——爱尔兰数据保护委员会最近裁定,谷歌没有充分详细说明将保护公民隐私的措施。⁴

- 有人猜测谷歌的员工政策,也是因为巴德曾提出过有争议的代码建议,可能是为了保护自己的声誉,在与微软资助的ChatGPT竞争数十亿美元的投资和广告收入。¹

以下是该故事出现的关键叙述:

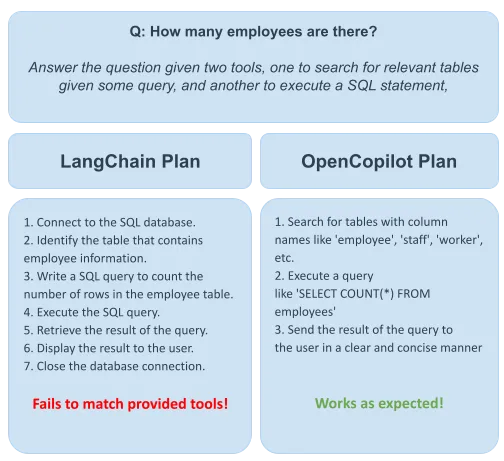

- 亲建制团体的叙述,由CSO Online提供。Google不仅对这项新兴技术的风险透明,而且在抵御数据盗窃、数据中毒和恶意聊天机器人激活方面处于前沿。该公司确实旨在从人工智能中获利,但同时也花费了大量资金确保公众安全和隐私。

- "Venture Beat提供了反建制的叙述。领导人工智能讨论的技术高管自认为是有神一般的先知,能够描述世界末日的情形,同时也能提供拯救的指引。虽然他们发表了一些关于人工智能可能带来的“存在威胁”的言论,但他们依然推动着技术的普及化,声称这会将我们带到一个技术治理的伊甸园。在这个时候,我们不应该相信他们的聊天机器人或他们自称的智慧。"

- Nerd叙事,由Metaculus提供。据Metaculus预测社区称,到2035年之前,在美国范围内AI获得法律权利或免遭滥用的概率为50%。

同时也试试我们的全功能网站、轻量版网站、新闻简报、iOS应用、安卓应用、Spotify播客和苹果播客。